Stellen Sie sich vor, Sie führen ein geschäftliches Telefonat mit einem Partner in Japan oder buchen ein Restaurant in Paris, ohne ein einziges Wort der Landessprache zu sprechen – und das völlig verzögerungsfrei. Für Millionen von Smartphone-Nutzern war dies lange Zeit nur mit umständlichen Drittanbieter-Apps und instabilen Internetverbindungen möglich. Doch ein unscheinbares System-Update hat eine Funktion freigeschaltet, die viele Samsung Galaxy Besitzer noch gar nicht entdeckt haben, obwohl sie die Art und Weise, wie wir kommunizieren, revolutioniert.

Das Besondere an dieser technologischen Wende ist nicht nur die Übersetzung selbst, sondern der Ort, an dem sie stattfindet. Während herkömmliche Tools Ihre sensiblen Gesprächsdaten zur Verarbeitung in die Cloud senden, nutzt diese neue Funktion eine versteckte Kraft direkt auf Ihrem Prozessor. Experten sprechen hier von einem Paradigmenwechsel in der Datensicherheit, der es ermöglicht, Sprachbarrieren in Echtzeit zu durchbrechen, ohne dass Ihre privaten Worte jemals das Gerät verlassen.

Die stille Revolution: On-Device KI vs. Cloud-Lösungen

Die Einführung der Galaxy AI markiert einen Wendepunkt in der mobilen Technologie. Im Gegensatz zu klassischen Übersetzungs-Apps, die auf eine Serververbindung angewiesen sind, nutzt das neue Update die Neural Processing Unit (NPU) des Smartphones. Dies garantiert nicht nur Datenschutz nach höchsten Standards, sondern eliminiert auch die typische Latenzzeit.

Vergleich: Warum lokale Verarbeitung überlegen ist

Um die Tragweite dieses Updates zu verstehen, lohnt sich ein direkter Vergleich der Technologien. Für den Endnutzer bedeutet dies konkrete Vorteile in Sicherheit und Geschwindigkeit.

| Feature | Traditionelle Cloud-App | Samsung Galaxy AI (Lokal) |

|---|---|---|

| Datenschutz | Daten werden auf fremde Server hochgeladen | Verarbeitung bleibt zu 100% auf dem Gerät |

| Latenzzeit | Verzögerung durch Netzwerk-Ping (>500ms) | Nahezu Echtzeit (<200ms) |

| Internetbedarf | Zwingend erforderlich (High-Speed) | Funktioniert auch offline (nach Sprachpaket-Download) |

| Gesprächspartner | Beide müssen oft die App haben | Funktioniert auch bei Anrufen ins Festnetz |

Diese Unabhängigkeit vom Internet für die reine Rechenleistung ist der Schlüssel für flüssige Gespräche, doch die technische Umsetzung erfordert spezifische Hardware.

Technische Voraussetzungen und unterstützte Modelle

- Google Maps verbirgt einen versteckten Offline-Modus für eine deutlich längere Akkulaufzeit

- Magnesium verliert durch den gleichzeitigen Konsum von Kaffee seine gesamte Wirkung

- Rindfleisch Patties trocknen durch das würzende Einmischen von Salz massiv aus

- Elektroauto Besitzer erhöhen ihre Winterreichweite durch simples Abkleben der Frontkühler

- Mayonnaise erzeugt auf gegrillten Nackensteaks die perfekte knusprige Kruste

Diagnose: Ist Ihr Gerät bereit?

Bevor Sie die Funktion aktivieren, sollten Sie sicherstellen, dass Ihre Hardware kompatibel ist. Experten raten dazu, folgende Spezifikationen zu prüfen:

| Modell-Reihe | Benötigter Prozessor-Typ | Verfügbarkeit Live-Translate |

|---|---|---|

| Galaxy S24 Ultra/Plus | Snapdragon 8 Gen 3 for Galaxy | Ab Werk installiert |

| Galaxy S23 Serie / S23 FE | Snapdragon 8 Gen 2 / Exynos 2200 | Via One UI 6.1 Update |

| Galaxy Z Fold5 / Flip5 | Snapdragon 8 Gen 2 | Via One UI 6.1 Update |

| Ältere Modelle (S22 etc.) | Diverse | Eingeschränkt oder Cloud-basiert (je nach Region) |

Wenn Ihr Gerät auf dieser Liste steht, ist der Weg zur sprachbarrierefreien Kommunikation nur noch wenige Klicks entfernt.

Aktivierung und Einrichtung: Eine Schritt-für-Schritt-Anleitung

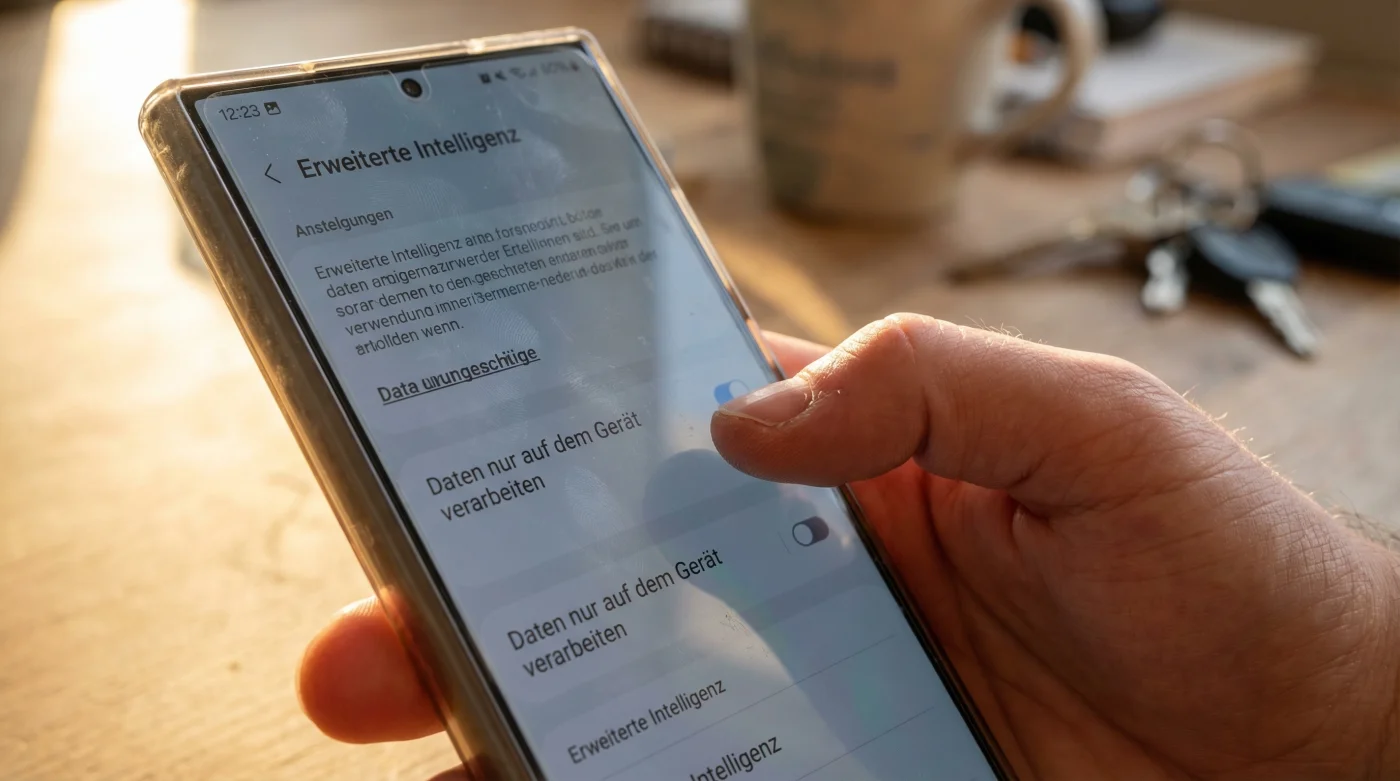

Die Funktion ist standardmäßig oft deaktiviert, um Ressourcen zu sparen. Um Live Translate zu nutzen, müssen Sie tief in die Systemeinstellungen eintauchen. Folgen Sie diesem Pfad präzise, um Fehlfunktionen zu vermeiden:

- Öffnen Sie die Einstellungen und navigieren Sie zu Erweiterte Funktionen.

- Wählen Sie den Punkt Intelligente Optimierung (Advanced Intelligence).

- Tippen Sie auf Telefon.

- Aktivieren Sie den Schalter für Live-Übersetzung.

- Wichtig: Laden Sie unter „Sprachen“ die benötigten Sprachpakete (z.B. Englisch, Französisch, Japanisch) herunter. Dies geschieht nur einmalig.

Fehlerbehebung: Symptom und Ursache

Falls die Übersetzung nicht wie gewünscht startet, liegt dies oft an trivialen Einstellungen. Hier eine diagnostische Übersicht:

- Symptom: Die Stimme klingt roboterhaft oder abgehackt.

Ursache: Das Sprachpaket wurde nicht vollständig heruntergeladen oder der Energiesparmodus drosselt die NPU. - Symptom: Der Gesprächspartner hört die Übersetzung nicht.

Ursache: Die Option „Stimme des Anrufers stummschalten“ ist nicht korrekt konfiguriert. - Symptom: Funktion nicht verfügbar.

Ursache: Das One UI 6.1 Update ist noch nicht installiert.

Die korrekte Konfiguration ist entscheidend, doch für ein professionelles Ergebnis müssen auch während des Telefonats gewisse Regeln beachtet werden.

Qualitätssicherung: Der Best-Practice Guide

Auch die beste KI stößt an Grenzen, wenn die akustischen Bedingungen schlecht sind. Studien belegen, dass Hintergrundgeräusche die Fehlerquote bei KI-Übersetzungen um bis zu 40% erhöhen können. Um Missverständnisse bei wichtigen Telefonaten zu vermeiden, sollten Sie folgende Protokolle einhalten.

| Aktion | Warum? (Wissenschaftlicher Hintergrund) | Empfehlung |

|---|---|---|

| Mikrofon-Position | KI benötigt klare Frequenztrennung für Syntax-Erkennung | Headset nutzen oder direkt ins Mikrofon sprechen |

| Satzbau | Verschachtelte Sätze (Hypotaxen) erhöhen die Prozessorlast | Kurze, klare Hauptsätze verwenden (Parataxen) |

| Sprechpausen | Die NPU benötigt ca. 200-500ms zur Verarbeitung des Kontextes | Nach jedem Satz eine kurze Pause lassen |

| Umgangssprache | Idiome und Dialekte sind in Trainingsdaten unterrepräsentiert | Hochdeutsch und standardisierte Ausdrücke nutzen |

Mit diesen Anpassungen verwandeln Sie Ihr Samsung Galaxy in einen professionellen Dolmetscher, der Ihnen weltweit Türen öffnet – ganz ohne Cloud-Risiko.